matrice de transition definition

|

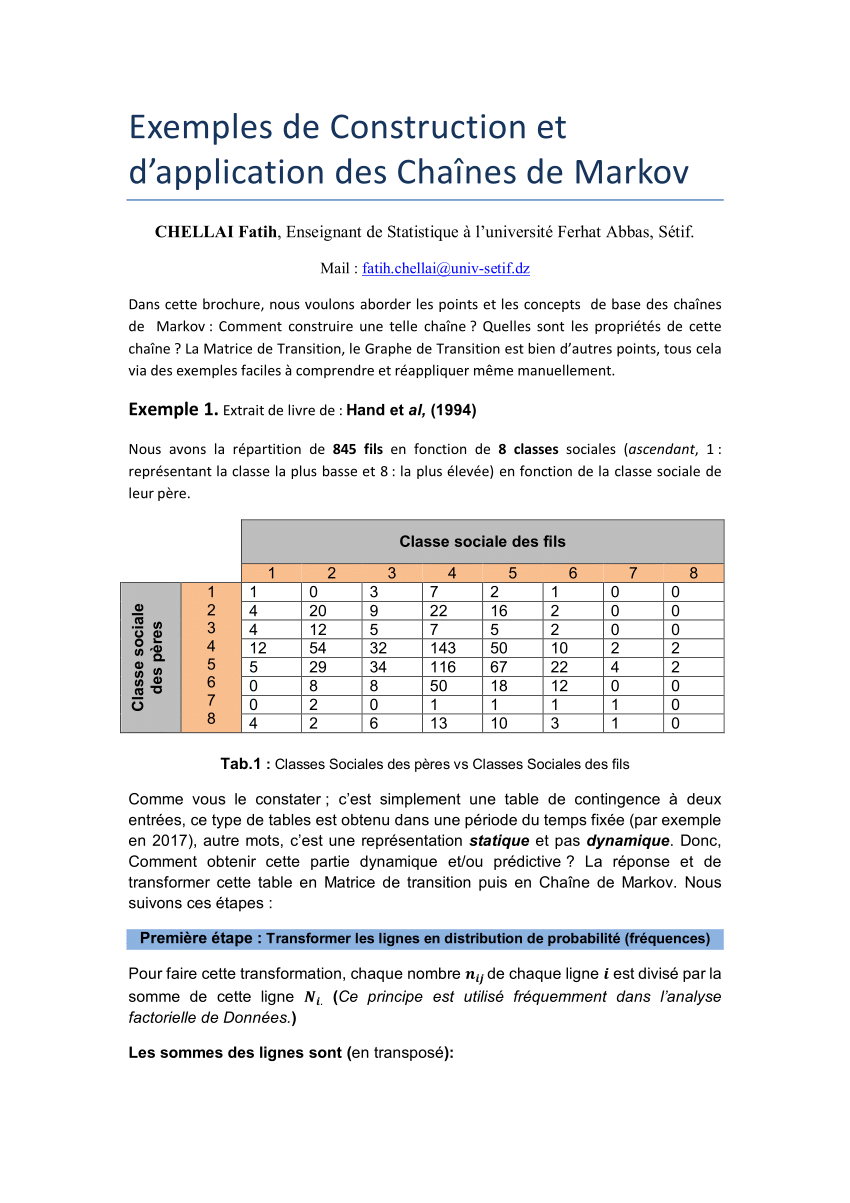

Introduction aux chaines de Markov

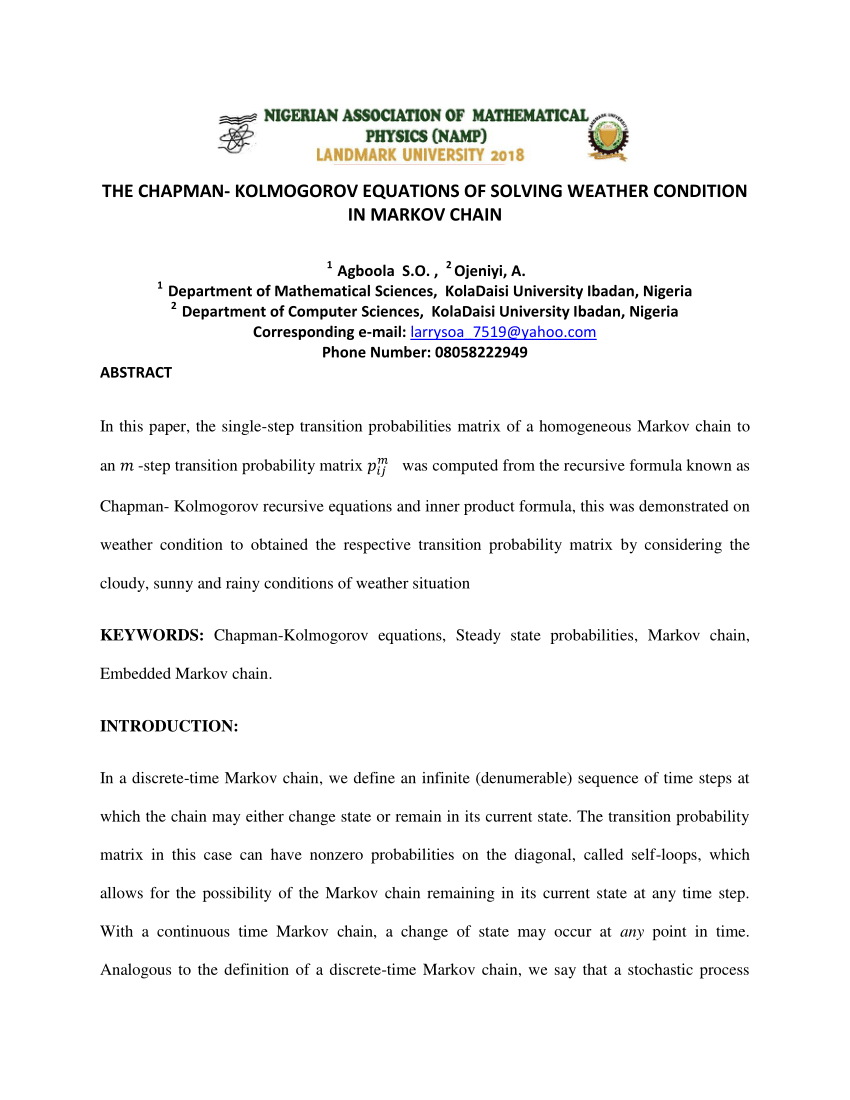

La matrice Q s'interpr`ete comme la matrice de transition de la chaıne de Markov X apr`es retournement du temps Définition I 1 11 On dit qu'une chaıne de |

|

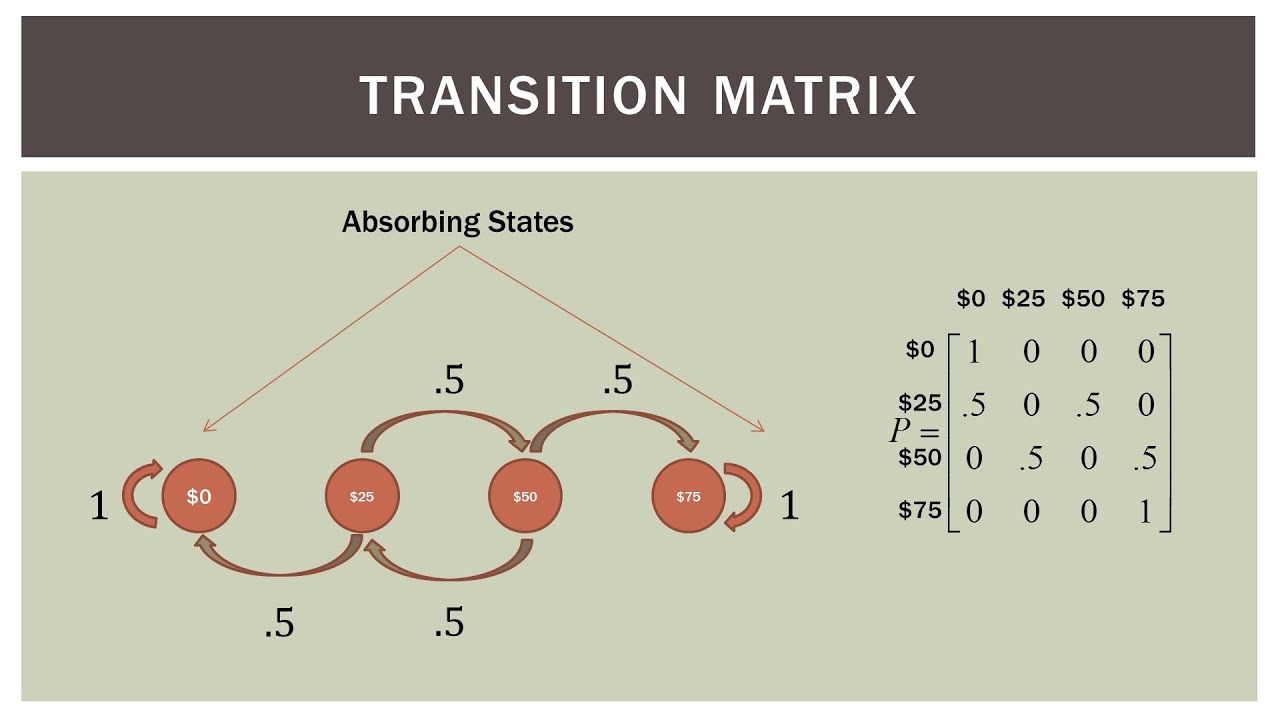

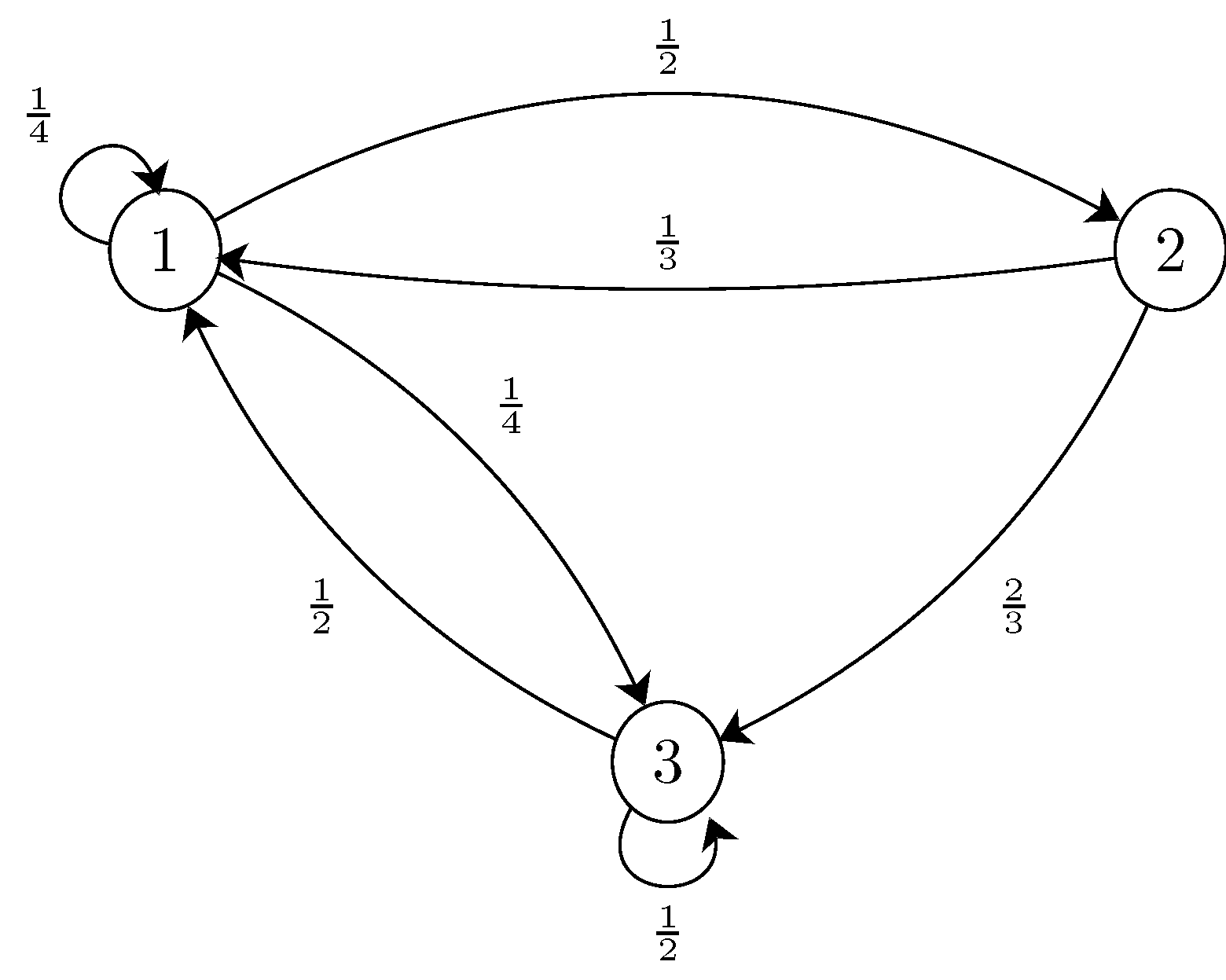

États Exemple: Matrice de transition

Exemple: États Le processus vérifie la propriété d'un processus de Markov ? 4 Exemple: Matrice de transition 5 Exemple: Coût de production et de maintenance |

|

Chapitre 8 Chaˆınes de Markov

Définition 8 1 6 S'il n'y a qu'une seule classe de communication la chaıne sa matrice de transition et son graphe de transition sont dits irréductibles Page |

|

Table des mati`eres

Par exemple pour n = 4 avec la matrice de transition P = 0 1 Definition mais l'avantage de la derni`ere formulation et qu'elle |

|

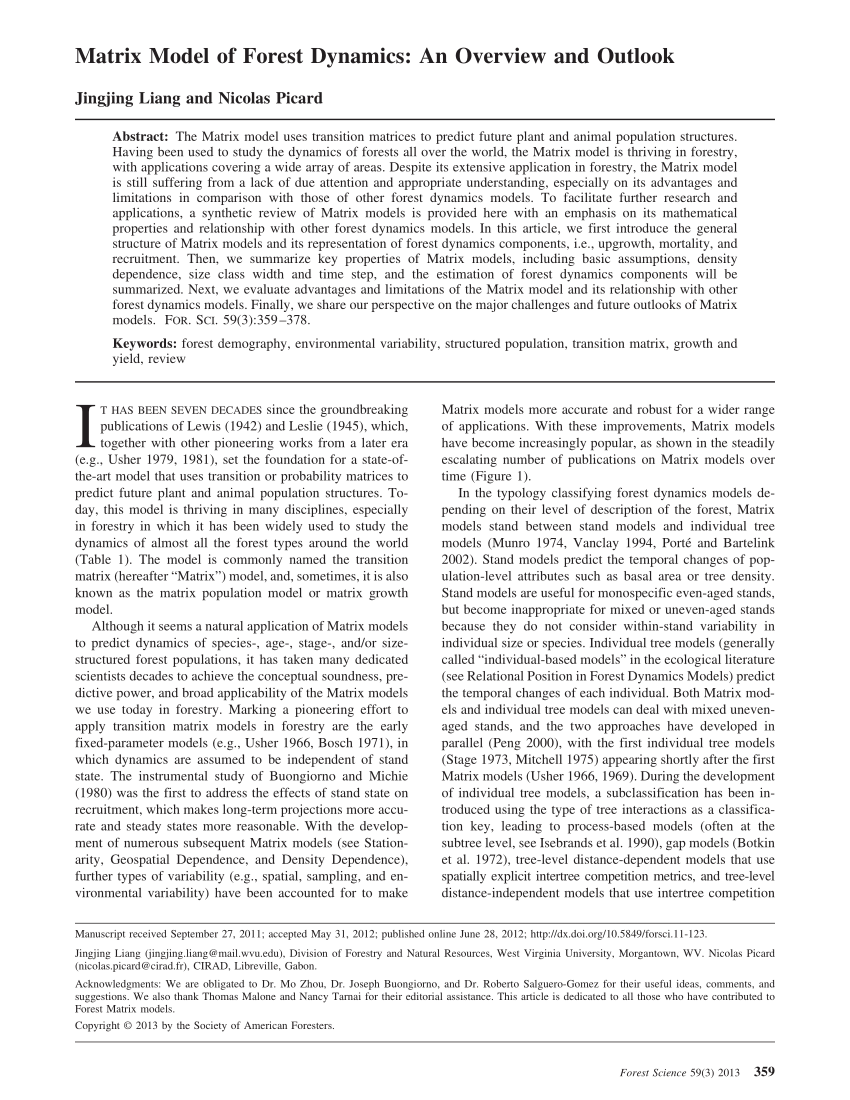

Résumé

Définition Une probabilité stationnaire d'une chaıne de Markov est une me- sure de probabilité π sur E telle que π = πP o`u P est la matrice de transition de la |

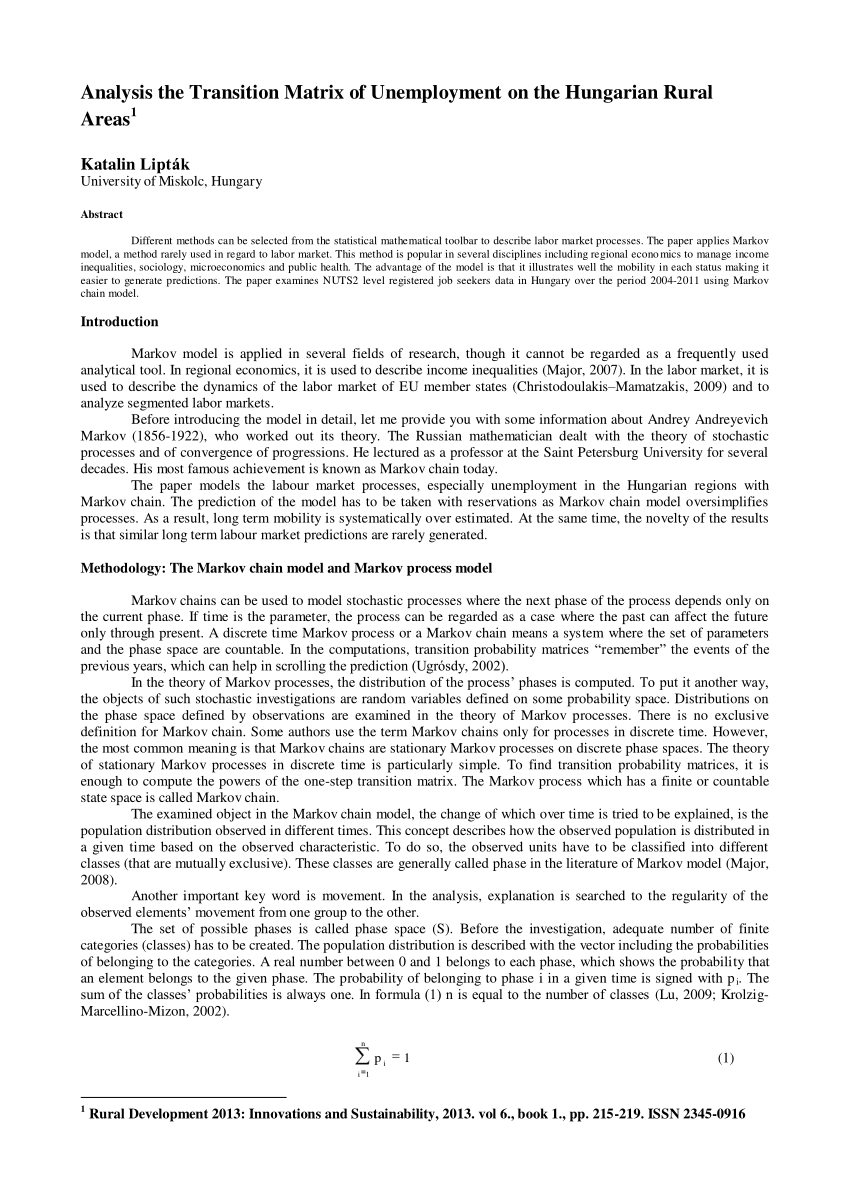

Quel est le principe Sous-jacent de la technique des chaines de Markov ?

Idée : Une chaîne de Markov est une suite de variables aléatoires dans le temps ou conditionnel- lement au présent, le futur ne dépend pas du passé, ou autrement dit le futur ne dépend du passé que par le présent.

Formellement, soit E un espace fini ou dénombrable.

Ce sera l'espace d'états.2 avr. 2019On dit qu'une chaıne de Markov, ou sa matrice de transition, est irréductible si pour tous x, y ∈ E, la probabilité partant de x d'atteindre y est strictement positive, autrement dit : si pour tous x, y ∈ E, il existe n = nx,y ≥ 1 (dépendant a priori de x et y) tel que Pn(x, y) > 0. n k=1 P(xk−1,xk) > 0.

C'est quoi une matrice de transition ?

La matrice de transition d'une marche aléatoire est la matrice carrée T = m i j T= m_{ij} T=mij dont le coefficient m i j m_{ij} mij est la probabilité de transition du sommet j vers le sommet i.

|

E. Les graphes probabilistes

Définition 1 Un graphe probabiliste est un graphe orienté et pondéré dans lequel : 2 État probabiliste et matrice de transition. Définition 2. |

|

Credit Transition Model 2017 Update: Methodology and

The Credit Transition Model (CTM) is Moody's proprietary issuer-level model of rating Appendix I Definition of Default by Moody's Investors Service. |

|

Recent advances in regional controllability of cellular automata

20-Dec-2019 matrice de transition en utilisant les définitions d'une chaîne ergodique et ... Définition 2 La configuration de l'automate cellulaire à ... |

|

Partie 1 : Graphes orientés et graphes pondérés

Définition : Soit un graphe orienté d'ordre dont les sommets sont numérotés de Définition : La matrice de transition d'une chaîne de Markov est la ... |

|

Chaînes de Markov

Définition 2.1 (Chaîne de Markov). Une chaîne de Markov sur X de matrice de transition P est une suite de variables aléatoires (Xn)n2Ndéfinies sur un espace (? |

|

CHAÎNES DE MARKOV

n?1 k=0 pxkxk+1 . ?. Définition 4. On appelle matrice de transition la matrice P = (px |

|

Chaînes de Markov

2 Matrice de transition. Définition 2.1 : Matrice de transition. Si la chaîne de Markov (Xn)n?N est homogène et si E est fini par exemple E = [[1 |

|

1 Définition

P est la matrice de transition de X. Ainsi (Xn)n est une chaîne de Markov si |

|

MATRICES ET GRAPHES

Définition : Une matrice de taille × est un tableau de nombres formé de Définition : La matrice de transition d'une chaîne de Markov est la ... |

|

Random walk on simplicial complexes

06-Jan-2021 plexes simpliciaux nous étendons la définition des noyaux de graphes basés ... Définition 5 (Matrice de transition). |

| 1 Définition |

| CHAÎNES DE MARKOV - Institut de Mathématiques de Bordeaux |

| Chapitre 8 Chaˆ?nes de Markov - DI ENS |

| Chaînes de Markov : théorie et applications |

| Résumé - Institut des actuaires |

| Chapitre 4 Chaˆ?nes de Markov finies |

| 1 Un exemple en microfinance |

| Matrice de transition non-homogène et reformulation hiérar - Papyrus |

| Introduction aux chaines de Markov - CERMICS |

| Chaînes de Markov et Processus markoviens de sauts Applications |

| Chaînes de Markov - Mathieu Mansuy |

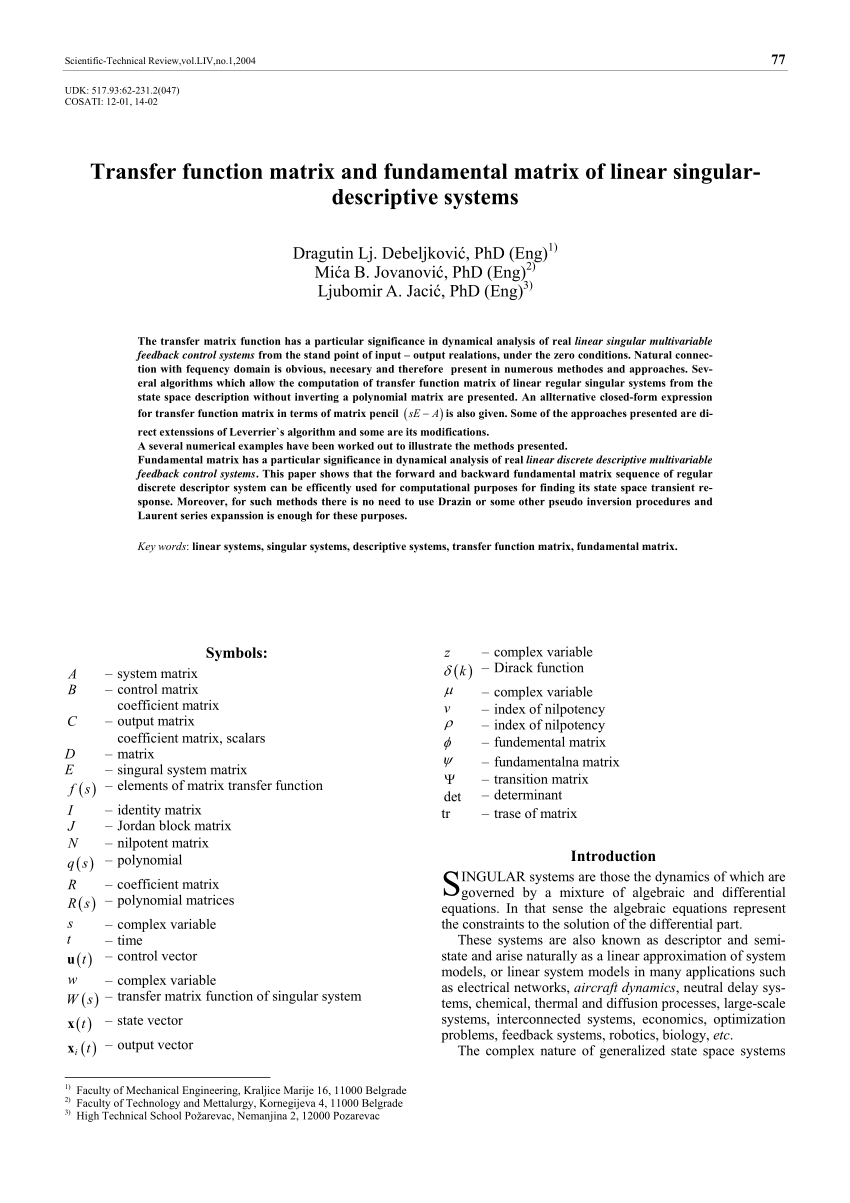

What is a transition matrix?

- The term "transition matrix" is used in a number of different contexts in mathematics. In linear algebra, it is sometimes used to mean a change of coordinates matrix . In the theory of Markov chains, it is used as an alternate name for for a stochastic matrix , i.e., a matrix that describes transitions.

What are n +1-dimensional transformation matrices?

- These n +1-dimensional transformation matrices are called, depending on their application, affine transformation matrices, projective transformation matrices, or more generally non-linear transformation matrices. With respect to an n -dimensional matrix, an n +1-dimensional matrix can be described as an augmented matrix .

What is the difference between Markov chain and state-transition matrix?

- In the theory of Markov chains, it is used as an alternate name for for a stochastic matrix , i.e., a matrix that describes transitions. In control theory, a state-transition matrix is a matrix whose product with the initial state vector gives the state vector at a later time.

Which transformations can be represented by matrices?

- Linear transformations are not the only ones that can be represented by matrices. Some transformations that are non-linear on an n-dimensional Euclidean space Rn can be represented as linear transformations on the n +1-dimensional space Rn+1. These include both affine transformations (such as translation) and projective transformations.

|

CHAÎNES DE MARKOV - Institut de Mathématiques de Bordeaux

Définition 5 2 Exemples 7 3 La relation de Chapman-Kolmogorov 9 4 Soit Xn est une chaîne de Markov de matrice de transition P, et soit ν0 la loi de X0 |

|

1 Définition

P est la matrice de transition de X Ainsi, (Xn)n est une chaîne de Markov si, en tout « temps » n, connaître la position « présente » Xn renseigne |

|

Graphes probabilistes et matrices de transitions Quest-ce quun

n'y a rien de précisé , on considère que les événements du graphe sont rangés par ordre alphabétique dans la matrice de transition Gardons notre exemple |

|

Chaînes de Markov et Processus markoviens de sauts Applications

transition de la chaîne Définition 3 Soit µ une probabilité sur E et P une matrice markovienne Un processus stochastique (Xn)n≥0 à valeurs dans E et défini sur |

|

Chaînes de Markov

Définition 2 1 (Chaîne de Markov) Une chaîne de Markov sur X de matrice de transition P est une suite de variables aléatoires (Xn)n2Ndéfinies sur un espace ( Ω, |

|

E Les graphes probabilistes - Lycée dAdultes

2 État probabiliste et matrice de transition Définition 2 Soit une expérience aléatoire à deux issues possibles A et B A chacune de ces issues est affectée une |

|

Chaînes de Markov (et applications)

22 fév 2021 · Définition 3 Soit Q la matrice de transition d'une chaîne de Markov homogène Etant donné un état x ∈ E, la mesure Qx(y) = Q(x, y) est une |

|

Chaînes de Markov

MATRICES DE TRANSITION DÉFINITION (ESPACE D'ÉTATS, MESURE) DANS TOUT LE COURS, E est un espace dénombrable Un élément |

|

Chaines de Markov : compléments

périodique C'est le cas d'une chaıne ayant une matrice de transition dont l'une des puissances Pk, k = 2,3, , vérifie Pk = P Par exemple on pourra vérifier que |